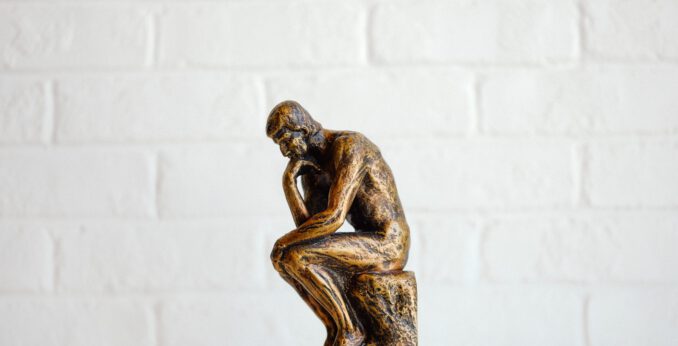

De mens is een zorgend wezen

Zorg is fundamenteel voor wie we zijn: door te zorgen voelen we ons betrokken bij de wereld. Maar wat is zorg eigenlijk?

Lees artikelNieuwste artikelen

‘Volgens MacIntyre hebben we de moraal laten versloffen’

De Schotse moraalfilosoof Alasdair MacIntyre pleit voor een herwaardering van Aristoteles’ deugdethiek. Filosoof Joep Dohmen legt uit waarom.

De terugkeer van de deugden

We hebben weer een gemeenschappelijke moraal nodig, schrijft filosoof Alasdair MacIntyre. En daarvoor kunnen we terecht bij Aristoteles.

Hoe weet je wat er in de ander omgaat?

Bert Keizer draait rondjes in zijn eigen hoofd en deelt dan een inzicht: Being Bert Keizer. Een shortread over de zin van filosofie.

Hebben we chaos nodig?

Hoe krijgen we vat op chaos? Een gesprek tussen de ‘oude’ Denker des Vaderlands Marjan Slob en de Jonge Denker Awaz Ahmad.

Ontdek Filosofie Magazine de eerste maand gratis!

Probeer een (online) abonnement voor minimaal 3 maanden en ontvang de eerste maand gratis!

Meest gelezen deze week

1.Martha Claeys wint Socratesbeker 2024

Socratesbeker 2.Hypatiaprijs: dit zijn de 5 beste filosofieboeken door vrouwen

Vrouwelijke denkers 3.Maxim Februari: ‘Het is belangrijk dat we de wet kunnen overtreden’

Mens en techniek 4.Tussen orde en chaos

Identiteit Voor leden 5.Ook Kant was geen moreel orakel

Driehonderd jaar Kant Voor ledenToekomstig evenement

Columns

Lees hier de columns uit Filosofie Magazine.

Helderheid is een wensdroom

Is de gedigitaliseerde en geglobaliseerde wereld nu echt zoveel chaotischer dan het leven op de savanne, vraagt Coen Simon zich af.

Soms moet je je wereldbeeld opnieuw opbouwen

De wereld begrijpen begint altijd vanuit een persoonlijk standpunt, schrijft Denker des Vaderlands Marjan Slob.

Goed mens

Vroeger wilde Miriam Rasch beroemd worden, nu ‘een goed mens’. Toch voelt ze zich niet helemaal senang bij die gedachte.

‘Je moet ervan genieten’

Praktisch filosoof Elke Wiss stelt elke maand vragen bij stellige uitspraken die ze tegenkomt.

Vraagstukken

Ontdek hier verschillende filosofische vraagstukken.